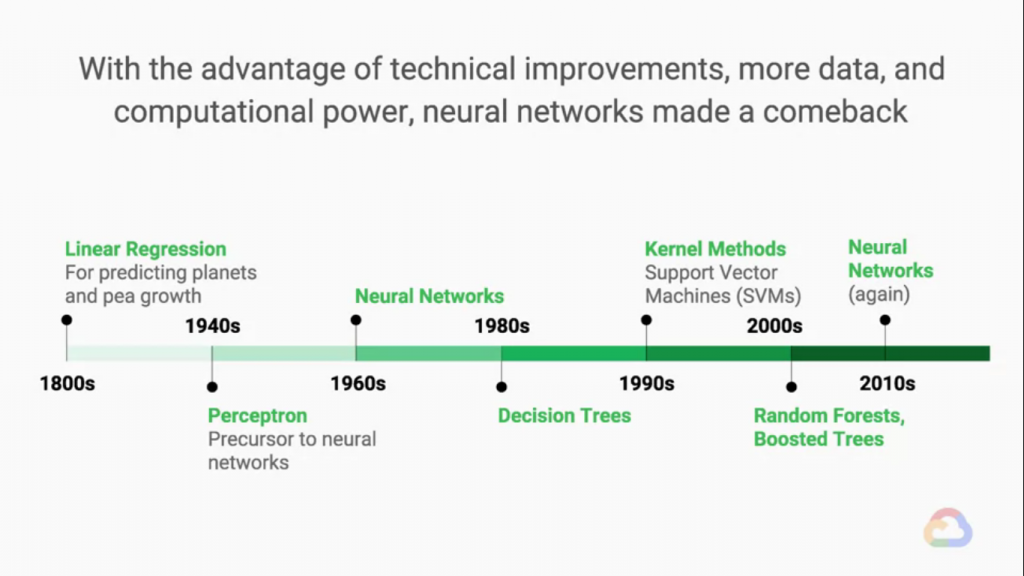

我們終於走到ML歷史的最後一段了!這代表我們要來談談神經網路啦!

其實神經網路並不是甚麼興新的技術!它其實在很久了,不過神經網路剛被提出時,

那個年代不管是在儲存、還是運算速度上都受到了限制,而在科技的發展下,現今我們的科技技術已經足以建構,

神經網路,且硬體架構已經可以負荷它的學習!於是神經網路又"活"了過來!

而我們已經發展神經網路並實際應用了大概8~10年了!在這中間我們對網路進行了許多優化,

目前我們已經可以說它基礎發展的已經差不多了,而我們最新提出的模型也只是建構在這些基礎上!

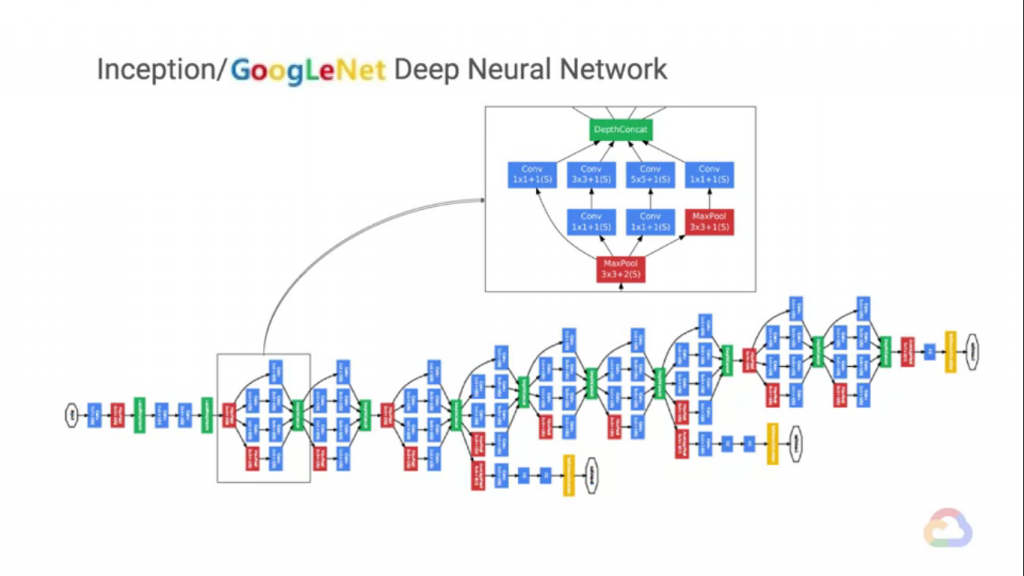

這是GoogleNet是Google在內部進行相片分類的模型,上面的圖只是簡單的畫基礎的架構,

這個模型裡有數百個神經層、上百萬個參數,不過這龐大的數字也帶給它有優秀的預測性能!

而Google也動用了100多萬張的相片來訓練它。裡頭的神經元包含著全連接和沒有全連接的層。

神經網路動用了以前各種技術,組合成了龐大且強大的模型!

超參數在訓練時也扮演著重要的腳色,在訓練時多嘗試,或甚至添加更多神經元,都是增進模型能力的方法。

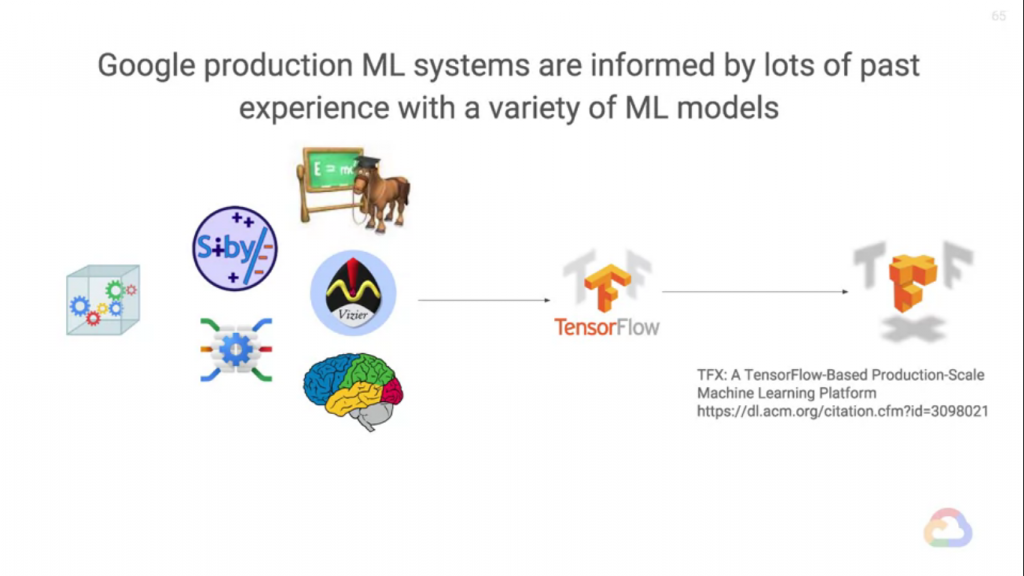

在Google內部,最後有超過4,000種生產型深度ML模型為其係統提供動力。

這些模型和版本中的每一個都可以基於過去模型的成功和失敗而獲得性能收益。

早期使用最廣泛的工具之一是Sibyl,它最初是為推薦相關的YouTube視頻而創建的。

這個推薦引擎效果很好,後來被廣泛地集成到廣告和Google的其他部分中。這是一個線性模型。

今年是另一個模型,最終成為其他模型和系統的實際參數調整引擎。Google Brain是Google內部的ML研究部門,

它創造了一種利用數千個CPU的計算能力來訓練大型模型(如深度神經網絡)的方法。[來自課程內容]

這就是TensorFlow成功的關鍵!在過去有Sibyl的開發經驗,促使了現在ML的框架TensorFlow的成熟

Google隨後創建了TFX或基於TensorFlow的機器學習平台。

使用TensorFlow和諸如Cloud ML Engine,Dataflow和BigQuery之類的工具構建和部署生產ML模型。

神經網路的發展快速,但是...

我們將為您提供的一個注意事項是,儘管神經網絡的性能對於某些應用程序可能非常好,

但它們只是可供您嘗試的多種類型的模型之一。實驗是使用數據來解決挑戰的最佳性能的關鍵。[來自課程內容]

方法沒有最好的,只有最適合的。